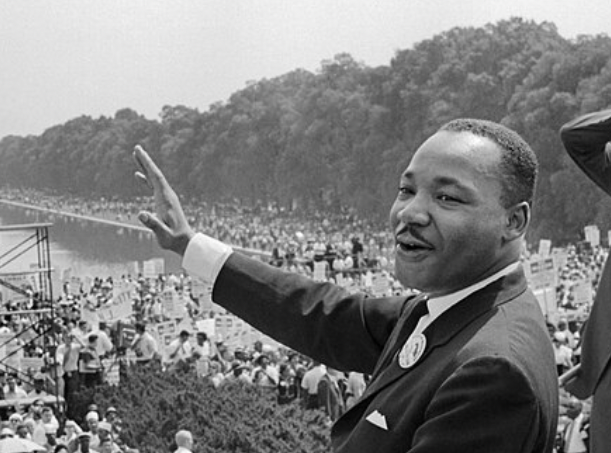

KI am Scheideweg: OpenAI zieht bei Martin Luther King Jr. die Notbremse für Deepfakes

Der Umgang mit KI-generierten Darstellungen realer Personen, auch historischer Figuren, ist rechtlich und ethisch heikel.

Nach Kritik am Einsatz von Martin Luther King Jr. hat OpenAI die Regeln für sein Video-KI-Modell Sora verschärft.

Hochschulen brauchen klare Richtlinien für den kreativen, aber verantwortungsvollen Einsatz solcher Technologien.

Tote können nicht klagen, dürften sich die Hersteller von Sora 2 gedacht haben, aber was seit dem Launch des neuen Video-KI-Generators sich an Leichenfledderei abspielt, dürfte sogar Sam Altman zum Nachdenken gebracht haben.

OpenAI hat nach Kritik des Martin-Luther-King-Jr.-Nachlasses die Regeln für sein Video-Modell Sora überarbeitet. Grund dafür waren KI-Videos, in denen der Bürgerrechtler realistisch dargestellt wurde, ohne dass Angehörige oder Rechteinhaber zugestimmt hatten. Künftig sollen Nachlassverwaltungen ein Vetorecht erhalten, ähnlich wie lebende Personen heute ihre Zustimmung geben müssen.

Der Fall zeigt, wie sensibel der Umgang mit historischen Persönlichkeiten ist, besonders, wenn KI-Systeme täuschend echte Inhalte erzeugen können.

Für Hochschulen bedeutet das: KI-Werkzeuge eröffnen große kreative Möglichkeiten, verlangen aber ebenso klare Richtlinien, Transparenz und die bewusste Reflexion von Persönlichkeitsrechten. Der Fall MLK erinnert uns daran, dass verantwortungsvoller KI-Einsatz nicht nur technisch, sondern ethisch und rechtlich gedacht werden muss.